Discours en direct, accès assisté et pointer et parler. Apple a présenté une série de services qui ont pour point commun l’accessibilité : l’objectif est de permettre à tous les utilisateurs d’utiliser le smartphone, même ceux qui vivent avec un handicap.

Apple a dévoilé une nouvelle gamme de services pour iPhone. Une nouvelle façon de téléphoner, une autre façon de faire défiler le menu du smartphone, de prendre des photos mais aussi d’observer ce qui se passe en dehors du téléphone. Différents modes pour ceux qui ont des besoins différents. La nouvelle gamme de services proposée par Apple pour iPhone est entièrement tournée vers l’accessibilité. Cela commence à partir du menu, Assistive Access vous permet de changer le menu de l’application en deux formats : les deux ont des icônes plus grandes qui occupent toute la longueur de l’écran. Il est également possible de les organiser en colonnes, afin de laisser le nom de l’application plus évident. Mais les deux fonctions les plus intéressantes sont celles qui intègrent l’intelligence artificielle.

Live Speech, l’application pour écrire des appels

Live Speech est optimisé pour fonctionner sur iPhone, iPad et MacBook. Ici, les utilisateurs peuvent écrire les phrases qu’ils veulent dire lors d’une conversation et les faire prononcer lors d’un appel téléphonique ou lors de l’utilisation de FaceTime. Pas seulement. Vous pouvez également enregistrer des phrases et les utiliser pour intervenir lors de conversations. Le but est de permettre même à ceux qui ne peuvent pas parler de participer. Ceux qui perdent l’usage de la parole, peut-être parce qu’ils souffrent d’une maladie dégénérative, peuvent utiliser Personal Voice, une fonction qui permet en 15 minutes de créer un clone de votre voix avec lequel vous pourrez ensuite donner de la voix à des textes. Il suffit de lire une série de phrases prédéfinies, un algorithme d’apprentissage automatique se chargera d’échantillonner tous nos sons et de les relier aux mots que nous écrivons sur le clavier.

Pointez et parlez, utilisez votre smartphone comme un nouvel œil

Apple a également introduit la fonctionnalité Point and Speak dans l’application Magnifier, qui fonctionne sur iPhone et iPad. Grâce à cette option, il est possible de lire tout ce qui est encadré par une caméra vidéo. L’exemple d’un appareil électroménager a été montré dans la vidéo de présentation. Une fois la section de commande encadrée, l’application lit toutes les options disponibles, aidant les utilisateurs malvoyants à comprendre comment se déplacer pour activer le programme dont ils ont besoin. L’algorithme sur lequel repose cette fonction peut également être utilisé pour décrire l’image qu’elle prend ou pour détecter la présence de portes ou de personnes.

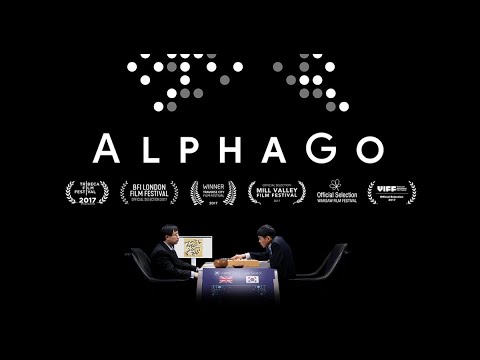

Découvrez le reportage du mois (sous-titré en français), l’IA gagnera t-elle face aux champion du monde du jeu de Go ? :