Dans son contexte : L’informatique de pointe est l’un des sujets les plus intrigants à l’origine de l’évolution du monde de la technologie. Après tout, comment ne pas être enthousiasmé par un concept qui promet d’apporter une intelligence distribuée à travers une multitude de ressources informatiques interconnectées travaillant toutes ensemble pour atteindre un objectif unique ?

Essayer de répartir les tâches informatiques sur plusieurs sites, puis de coordonner ces différents efforts en un tout cohérent et significatif est beaucoup plus difficile qu’il n’y paraît. Cela est particulièrement vrai lorsque vous tentez de transformer de petits projets de preuve de concept en une production à grande échelle.

Des problèmes tels que le déplacement d’énormes quantités de données d’un endroit à l’autre – ce qui, ironiquement, était censé être inutile avec l’informatique de pointe – ainsi que les demandes écrasantes pour étiqueter ces données ne sont que deux des nombreux facteurs qui ont concouru à faire des déploiements d’informatique de pointe réussis le l’exception par opposition à la règle.

Le groupe de recherche d’IBM travaille depuis plusieurs années pour aider à surmonter certains de ces défis. Récemment, ils ont commencé à voir le succès dans des environnements industriels comme la fabrication automobile en adoptant une approche différente du problème. En particulier, l’entreprise a repensé la manière dont les données sont analysées à divers emplacements périphériques et la manière dont les modèles d’IA sont partagés avec d’autres sites.

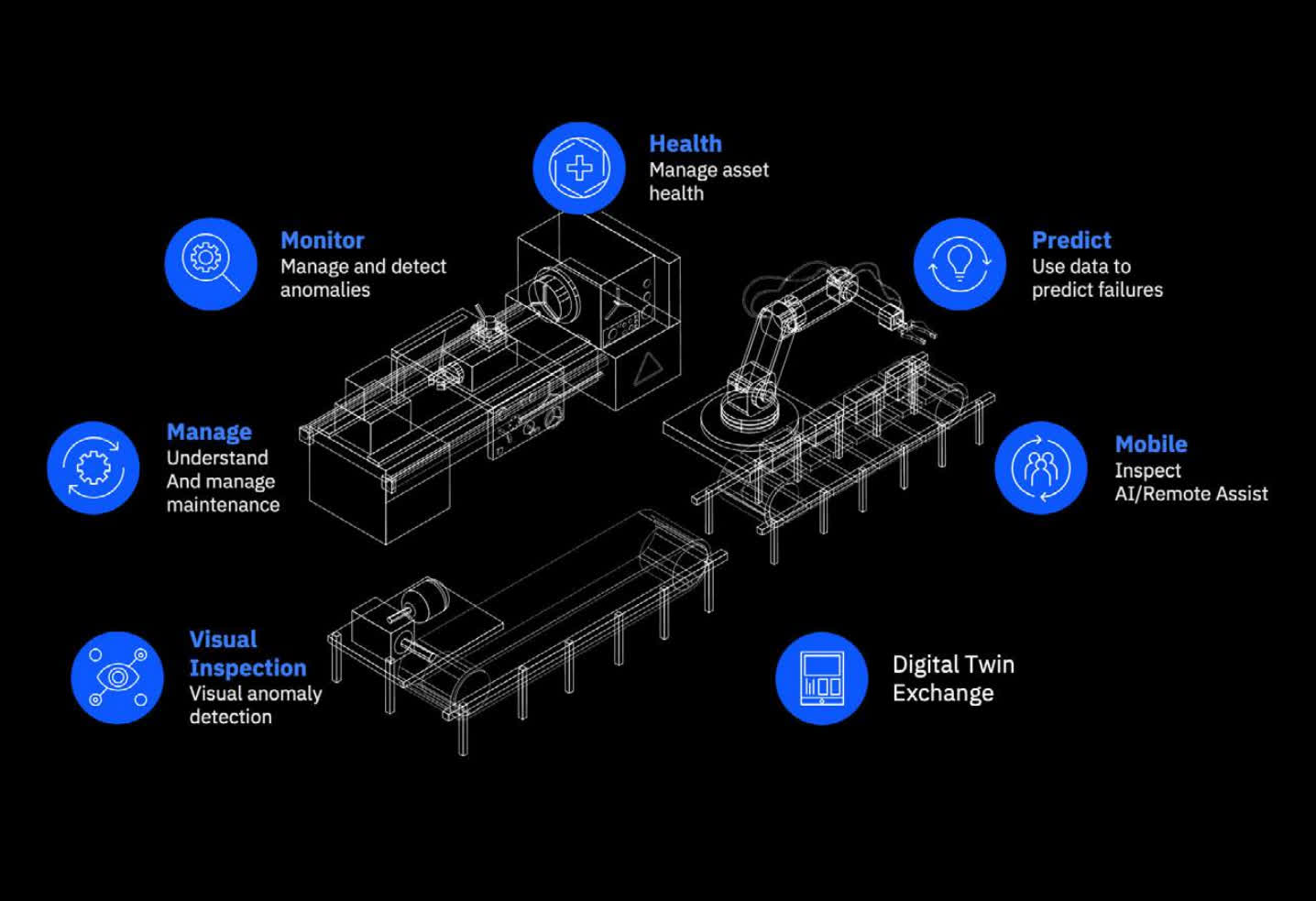

Dans les usines de fabrication de voitures, par exemple, la plupart des entreprises ont commencé à utiliser des modèles d’inspection visuelle alimentés par l’IA qui aident à repérer les défauts de fabrication qui peuvent être difficiles ou trop coûteux à reconnaître pour les humains. L’utilisation appropriée d’outils tels que la solution d’inspection visuelle avec zéro D (défauts ou temps d’arrêt) d’IBM Maximo Applications Suite, par exemple, peut à la fois aider les constructeurs automobiles à économiser des sommes importantes en évitant les défauts et à maintenir les lignes de fabrication le plus rapidement possible. Compte tenu des contraintes liées à la chaîne d’approvisionnement auxquelles de nombreuses entreprises automobiles ont été confrontées récemment, ce point est devenu particulièrement critique ces derniers temps.

La véritable astuce, cependant, consiste à accéder à l’aspect Zero D de la solution, car des résultats incohérents basés sur des données mal interprétées peuvent en fait avoir l’effet inverse, en particulier si ces données erronées finissent par être promulguées sur plusieurs sites de fabrication via des modèles d’IA inexacts. Pour éviter des arrêts coûteux et inutiles de la chaîne de production, il est essentiel de s’assurer que seules les données appropriées sont utilisées pour générer les modèles d’IA et que les modèles eux-mêmes sont vérifiés régulièrement pour leur exactitude afin d’éviter tout défaut qui pourrait mal étiqueter les données. pourrait créer.

Ce « recalibrage » des modèles d’IA est l’essentiel de la sauce secrète qu’IBM Research apporte aux constructeurs et notamment à un grand équipementier automobile américain. IBM travaille sur quelque chose qu’ils appellent des algorithmes de détection hors distribution (OOD) qui peuvent aider à déterminer si les données utilisées pour affiner les modèles visuels sont en dehors d’une plage acceptable et pourraient, par conséquent, amener le modèle à effectuer une inférence inexacte sur les données entrantes. . Plus important encore, il effectue ce travail de manière automatisée pour éviter les ralentissements potentiels qui résulteraient d’efforts d’étiquetage humains chronophages, ainsi que pour permettre au travail de s’étendre sur plusieurs sites de fabrication.

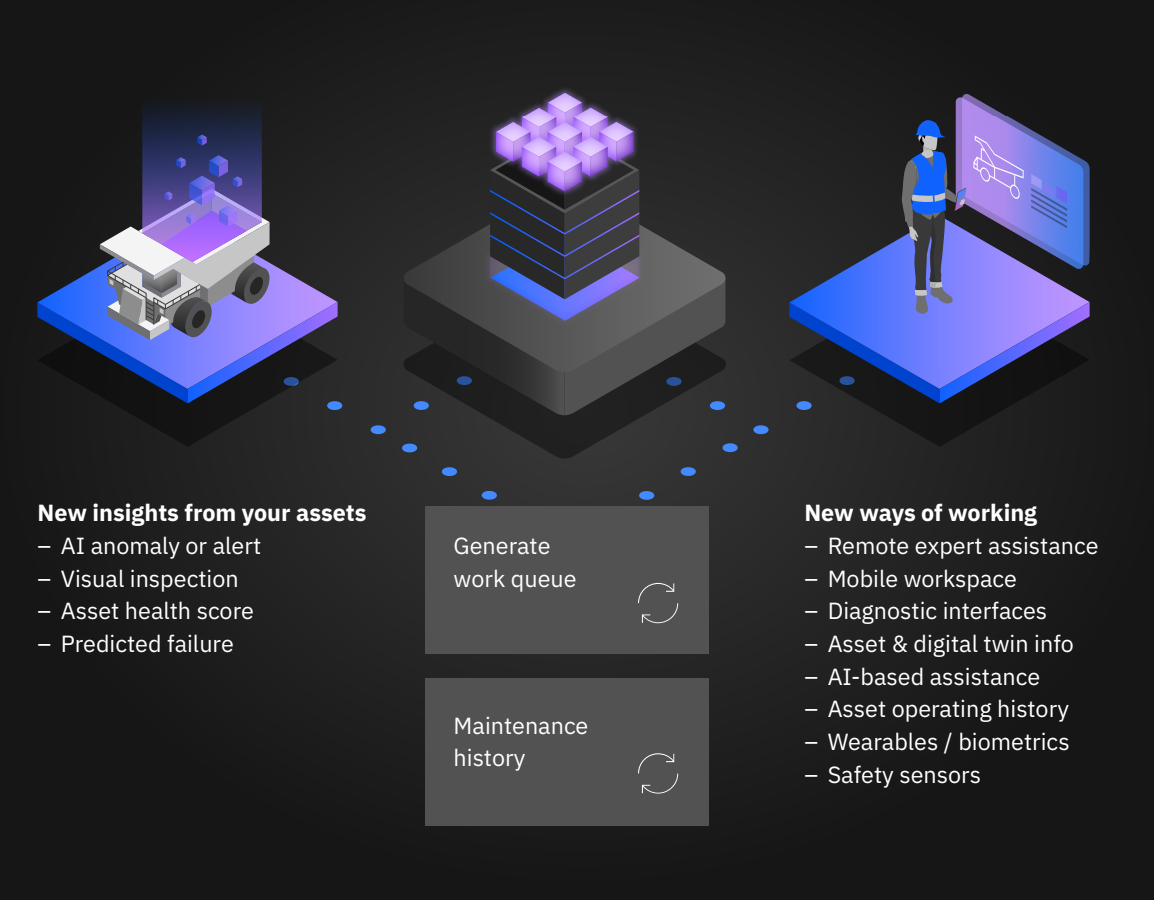

Un sous-produit de la détection OOD, appelé résumé des données, est la possibilité de sélectionner des données pour une inspection manuelle, l’étiquetage et la mise à jour du modèle. En fait, IBM travaille sur une réduction de 10 à 100 fois de la quantité de trafic de données qui se produit actuellement avec de nombreux déploiements informatiques de pointe. De plus, cette approche permet une utilisation 10 fois supérieure des heures-personnes consacrées à l’inspection manuelle et à l’étiquetage en éliminant les données redondantes (images presque identiques).

En combinaison avec des techniques de pointe telles que l’exploration d’architecture de modèle OFA (Once For All), la société espère également réduire la taille des modèles jusqu’à 100 fois. Cela permet des déploiements informatiques en périphérie plus efficaces. De plus, en conjonction avec des technologies d’automatisation conçues pour distribuer plus facilement et plus précisément ces modèles et ensembles de données, cela permet aux entreprises de créer des solutions de pointe alimentées par l’IA qui peuvent passer avec succès de POC plus petits à des déploiements de production complets.

Des efforts comme celui qui est exploré chez un grand équipementier automobile américain sont une étape importante dans la viabilité de ces solutions pour des marchés comme la fabrication. Cependant, IBM voit également l’opportunité d’appliquer ces concepts de raffinement des modèles d’IA à de nombreux autres secteurs, notamment les télécommunications, la vente au détail, l’automatisation industrielle et même la conduite autonome. L’astuce consiste à créer des solutions qui fonctionnent malgré l’inévitable hétérogénéité qui se produit avec l’edge computing et à tirer parti de la valeur unique que chaque site d’edge computing peut produire par lui-même.

À mesure que l’edge computing évolue, il est clair qu’il ne s’agit pas nécessairement de collecter et d’analyser autant de données que possible, mais plutôt de trouver les bonnes données et de les utiliser aussi judicieusement que possible.