Des milliers de personnes ont cru ces images, même s’il y avait des indications qu’il s’agissait de fausses photographies. Avec les nouvelles technologies, il sera de plus en plus difficile de distinguer le vrai du faux.

Le diable se cache dans les détails, surtout lorsqu’il s’agit d’images générées par l’intelligence artificielle (IA). Des clichés de Donald Trump arrêté par la police font le tour des réseaux sociaux. Il y a aussi des photographies de l’ancien président alors qu’il s’enfuit dans les couloirs du MacDonald’s, joue au basket avec les détenus ou choisit son uniforme en prison. Aucune de ces images n’est vraie. Certains ne sont que de faux collages, d’autres sont réalistes. L’astuce pour ne pas tomber dans le piège de l’IA est toujours la même : faites attention aux détails.

Malgré leurs hautes performances quelque chose s’échappe toujours, un bord flou, une mauvaise perspective, une disproportion ou une lumière déplacée. En regardant les images de Trump générées par l’intelligence artificielle, par exemple, on peut voir des parties du corps plus grandes que d’autres, ou des positions étranges que prennent les jambes. À première vue, il semble qu’ils soient vrais, mais les détails trahissent le caractère synthétique. Celles de Trump d’ailleurs ne sont même pas les seules fausses images produites par l’IA qui ont été publiées ces derniers jours. Le (faux) plan de Poutine agenouillé devant Xi Jinping a été produit par un logiciel, pourtant, même si même dans ce cas il y avait des détails évidents, comme la chaussure mal formée ou la tête trop grosse, beaucoup l’ont pris pour réel.

Pour renforcer cette perception, il existe clairement des préjugés idéologiques. Et cela explique pourquoi le tweet a été partagé des milliers de fois. C’est une nouvelle qui divise et qui pousse des sentiments forts, qu’ils soient d’indignation ou d’enthousiasme, cela s’applique aussi à l’image de Poutine à genoux. Et ce n’est que le début. L’intelligence artificielle au service des fake news va devenir de plus en plus dangereuse à mesure que les technologies évoluent. Il viendra un moment où même ces détails mal placés seront corrigés. Alors comment va-t-on distinguer le vrai du faux ?

Pourquoi des images de l’arrestation de Trump ont été générées

La première fausse image a été postée sur Twitter avec cette légende : « #BREAKING : Donald J. Trump a été arrêté à #Manhattan ce matin. » Les photos n’ont pas été générées au hasard. Donald Trump a en effet déclaré qu’il risquait d’être arrêté, selon l’ancien président, les agents devaient se présenter mardi 21 mars. Les autorités new-yorkaises l’ont accusé d’avoir acheté le silence de la star du porno Stormy Daniels, et de lui avoir donné 130 000 dollars pour l’empêcher de révéler leur rapport en pleine élection présidentielle de 2016 En réalité, les enquêtes sont toujours en cours, mais Donald Trump poursuit le travail, et a d’ailleurs écrit dans un post : « Protestez, reprenez la nation » en cas d’arrestation. Avec le même appel, il avait déchaîné l’enfer sur Capitol Hill Il est encore plus important dans ce cas de faire la part des choses entre les fausses et les vraies images.

Le deepfake qui crée la désinformation

L’expert en IA et Deepfake, Henry Ajder, a expliqué à Newsweek que si les photos de Trump peuvent être remarquablement fausses pour les personnes ayant une formation en IA, d’autres peuvent les percevoir différemment. « Ces images pourraient être partagées dans des espaces d’information plus isolés et confinés, où elles sont encadrées différemment par des personnes qui recherchent une confirmation et essentiellement une sortie, des images qui montrent que Trump est arrêté pour susciter l’indignation ou la joie dans certains cas. »

De plus, en publiant ces photos sur les réseaux sociaux, où les gens sont susceptibles de faire défiler rapidement les chronologies, il est difficile de s’attarder sur les mauvais détails. Dans une interview au Daily Beast, l’experte en désinformation et chercheuse de Harvard Joan Donavan a expliqué que « malheureusement ces outils de création d’images réalistes sont très utiles pour tromper le public. Nous assistons à une nouvelle forme de désinformation préventive, où les rumeurs se concrétisent à travers la création de médias qui couvrent des événements qui ne se sont jamais produits. »

Les astuces pour découvrir la supercherie

En plus des compositions incorrectes et des proportions erronées, il existe d’autres moyens de savoir si une image a été générée par une intelligence artificielle. Comme l’explique sur Twitter Eliot Higgins, fondateur de Bellingcat, le site de journalisme d’investigation spécialisé dans la vérification des faits et le renseignement open source, un bon moyen de reconnaître la main de l’IA est de chercher des écritures sur les murs, les panneaux ou les vêtements, désordonnées et dénuées de sens. des textes apparaissent souvent. Par exemple, sur les photos de Trump, les inscriptions sur les chapeaux des policiers ne sont que des lettres aléatoires.

Non seulement cela, les expressions faciales sont également un indice utile. « J’ai également remarqué que si vous demandez des expressions, Midjourney a tendance à les rendre exagérées, avec des plis cutanés dus à des choses comme le sourire très prononcé », a déclaré Higgins. Par exemple, l’expression douloureuse sur le visage de Melania Trump ressemble à une image d’un film d’horreur. Il est clair que les visages de personnes connues peuvent sembler plus convaincants car l’IA, disposant de nombreuses photographies, est capable de produire des images plausibles. « Alors le les personnages célèbres sont très bien rendusalors que les personnes moins célèbres sont généralement un peu bancales ». Higgins a posté les photos de Trump, en précisant qu’elles étaient fausses, pour montrer les risques et plutôt mettre en évidence les imperfections qui permettent de reconnaître l’intervention de l’IA.

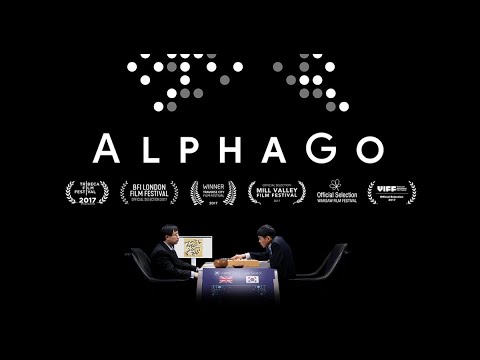

Découvrez le reportage du mois (sous-titré en français), l’IA gagnera t-elle face aux champion du monde du jeu de Go ? :