La National Eating Disorders Association a commencé à utiliser l’intelligence artificielle pour soutenir les personnes souffrant de boulimie, d’anorexie ou d’hyperphagie boulimique. Le résultat a été un désastre et le chatbot a été supprimé.

C’était censé être la révolution des chatbots bien-être, et à la place on est face à une intelligence artificielle qui dit : « Compte les calories » à une personne qui a un trouble du comportement alimentaire. Pas un début fulgurant pour la National Eating Disorders Association (NEDA), l’association à but non lucratif qui a lancé fin mai Tessa, l’IA (qui devait l’être) capable d’accompagner les personnes souffrant d’anorexie, de boulimie, ou trouble de l’hyperphagie boulimique. Il avait annoncé son nouveau chatbot avec enthousiasme et une longue liste de données, d’études et d’avis d’experts certifiant Tessa. Il a également licencié le personnel du centre d’appels qui soutenait les clients jusqu’à ce moment-là. Puis les choses ont vite mal tourné.

« Il a été porté à notre attention hier soir que la version actuelle de Tessa Chatbot, qui gère le programme Body Positive, pourrait avoir fourni des informations nuisibles et sans rapport avec le programme », a déclaré l’organisation dans un communiqué publié mardi sur Instagram. « Nous enquêtons immédiatement et avons supprimé ce programme jusqu’à nouvel ordre pour une enquête complète. »

Les chatbots de bien-être sont une nouvelle mode

« Salut, je suis Tessa. Je suis un chatbot de support à la santé mentale ici pour vous aider à vous sentir mieux chaque fois que vous avez besoin de parler sans jugement, jour et nuit. » Ce message est apparu aux clients de la National Eating Disorders Association, le premier à répondre était le personnel de la Hotline était un changement attendu depuis longtemps et que l’IA pourrait mieux servir les personnes souffrant de troubles de l’alimentation », a écrit Abbie Harper, membre de l’agence de presse NPR. Le syndicat d’assistance luttant aux côtés des travailleurs de la ligne d’assistance NEDA. Mais ce n’était pas le cas.

Les chatbots de bien-être poussent comme des champignons. Par exemple, une intelligence artificielle a été lancée pour faire une séance de psychanalyse (on a essayé et ça ne s’est pas bien passé), puis il y a des logiciels de motivation, ou tout simplement pour se sentir moins seul. Pour former la technologie, les entreprises font appel à des psychologues, des thérapeutes et des experts du secteur, leur travail consiste à enseigner à l’IA comment gérer les difficultés des gens, en l’occurrence les troubles alimentaires. Et bien que les chatbots aient appris à voler des phrases bien formulées pour donner des réponses cohérentes, ils restent des perroquets artificiels, ils ne peuvent pas remplacer les gens. Et de fait, lorsque les internautes ont tenté de parler à Tessa, ils se sont non seulement retrouvés face à une (inévitable) absence d’humanité, mais aussi face à des réponses dangereuses.

Comment Tessa fonctionne

Le porte-parole de la NEDA a déclaré à Motherboard que Tessa a été testée sur 700 femmes entre novembre 2021 et 2023, dont 375 ont attribué à Tessa une note positive. « Lorsque les chercheurs ont conclu leur évaluation de l’étude, ils ont constaté que le succès de Tessa démontre les avantages potentiels des chatbots en tant qu’option abordable, facilement accessible et non stigmatisante pour la prévention et l’intervention en matière de troubles de l’alimentation. »

Il a été créé par une équipe de recherche de la Washington University Medical School dirigée par le Dr Ellen Fitzsimmons-Craft. « Le chatbot a été construit sur la base de décennies de recherches menées par mes collègues et moi. Je ne sous-estime en aucun cas la volonté potentielle de parler à quelqu’un de ses préoccupations. C’est un service complètement différent conçu pour enseigner aux gens des stratégies basées sur des preuves. prévenir et fournir une intervention précoce pour les symptômes des troubles de l’alimentation », a déclaré Fitzsimmons-Craft avant le lancement officiel.

Les plaintes des clients

Puis les premières plaintes sont apparues, elles se sont multipliées, les utilisateurs ont souligné des réponses insuffisantes ou des conversations inadaptées notamment pour ceux qui sont confrontés à un trouble, en l’occurrence alimentaire. Selon Liz Thompson, PDG de NEDA, il y a eu « abus » par des « mauvais acteurs » qui ont tenté de tromper l’intelligence artificielle. NEDA n’a fait aucune déclaration officielle sur les réponses de Tessa, mais des commentaires et des captures d’écran sur les réseaux sociaux montrent les indications dangereuses du chatbot. Par exemple, il a conseillé à une personne souffrant d’un trouble de l’alimentation de compter les calories et d’essayer de perdre du poids.

« Un chatbot ne remplace pas l’empathie humaine, et nous pensons que cette décision causera un préjudice irréparable à la communauté des troubles de l’alimentation », ont déclaré Helpline Associates United et d’anciens employés qui ont été licenciés de l’entreprise après leur arrivée à Motherboard de Tessa. Une déclaration qui en très peu de temps est devenue réalité.

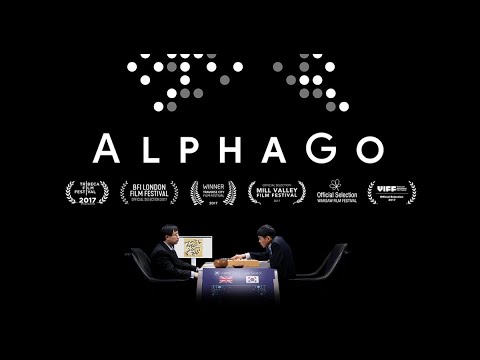

Découvrez le reportage du mois (sous-titré en français), l’IA gagnera t-elle face aux champion du monde du jeu de Go ? :