Il y a eu des opinions divergentes sur les risques pour l’humanité posés par l’intelligence artificielle, certains allant même jusqu’à suggérer que l’IA pourrait entraîner l’extinction des humains. Étonnamment, cependant, ce dernier point de vue est partagé par de nombreux experts de premier plan en intelligence artificielle – y compris les PDG d’OpenAI et de Google DeepMind…

C’est le genre de déclaration que vous attendez normalement des théoriciens du complot vivant dans le sous-sol de leur mère, mais celui-ci ne pourrait pas avoir des références plus impeccables. Les signataires sont comme un Who’s Who de la technologie en général, et de la science de l’IA en particulier.

Les signataires comprennent des universitaires de renom et, fait révélateur, à la fois Sam Altman, PDG d’OpenAI, et Demis Hassabis, PDG de Google DeepMind.

L’avertissement se présente sous la forme d’une seule phrase :

L’atténuation du risque d’extinction de l’IA devrait être une priorité mondiale aux côtés d’autres risques à l’échelle de la société tels que les pandémies et la guerre nucléaire.

Un préambule indique que la déclaration vise à ouvrir la discussion, mais indique également qu’un nombre croissant d’experts pensent sincèrement que les enjeux pourraient être aussi élevés.

Les experts en IA, les journalistes, les décideurs et le public discutent de plus en plus d’un large éventail de risques importants et urgents liés à l’IA. Même ainsi, il peut être difficile d’exprimer des inquiétudes concernant certains des risques les plus graves de l’IA avancée. L’énoncé succinct ci-dessous vise à surmonter cet obstacle et à ouvrir la discussion. Il vise également à créer une connaissance commune du nombre croissant d’experts et de personnalités publiques qui prennent également au sérieux certains des risques les plus graves de l’IA avancée.

Le NY Times note que les signataires incluent également deux des plus grands noms de l’IA.

Geoffrey Hinton et Yoshua Bengio, deux des trois chercheurs qui ont remporté un prix Turing pour leur travail de pionnier sur les réseaux de neurones et sont souvent considérés comme les « parrains » du mouvement moderne de l’IA, ont signé la déclaration, tout comme d’autres chercheurs éminents dans le domaine (The le troisième lauréat du prix Turing, Yann LeCun, qui dirige les efforts de recherche sur l’IA de Meta, n’avait pas signé mardi.)

Il fait suite à une lettre ouverte antérieure appelant à une pause de six mois sur le développement de modèles d’IA générative plus avancés. Les signataires comprenaient le cofondateur d’Apple, Steve Wozniak.

La lettre indique que le développement actuel de l’IA est hors de contrôle et peut poser « des risques profonds pour la société et l’humanité ».

La dernière lettre a été décrite comme un « coming out » pour les experts de l’IA qui ont exprimé leurs préoccupations en privé, mais ont jusqu’à présent eu peur de le faire publiquement par peur du ridicule. La lettre offre une sécurité en nombre et en réputation, car il faudrait maintenant qu’une personne encore plus courageuse écarte les craintes exprimées par tant de sommités.

Quelle est ton opinion? L’IA pourrait-elle représenter une menace existentielle pour l’humanité ? S’il vous plaît partager vos pensées sur nos réseaux sociaux.

Image : Google DeepMind/Unsplash

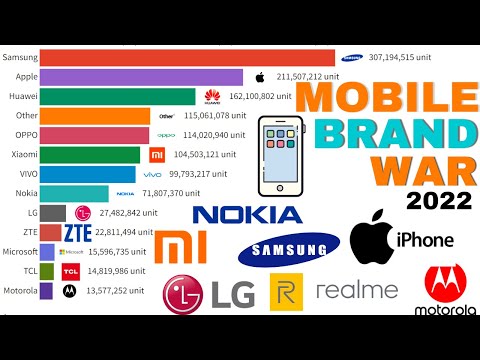

Détente, découvrez l’évolution du nombre de smartphones vendus par marque au fil du temps dans la vidéo ci-dessous :