Le cofondateur d’Apple, Steve Wozniak (alias Woz), a déclaré que la marche de l’IA ne peut être arrêtée – même s’il a appelé à une pause dans le développement – et que nous devons nous préparer à ce que les personnes en abusent pour créer des escroqueries plus difficiles à repérer…

Arrière-plan

Même les pionniers de l’intelligence artificielle ne s’entendent pas sur sa dangerosité, deux des plus grands noms exprimant cette semaine des points de vue opposés.

Geoffrey Hinton est souvent désigné comme « l’un des parrains de l’IA ». Il est une figure clé du développement des réseaux de neurones, a écrit de nombreux articles et a remporté de nombreux prix pour son travail dans le domaine.

Il était tellement préoccupé par les dangers du travail actuel sur l’IA qu’il a quitté son poste chez Google afin d’être libre de parler librement des risques. […]

Jürgen Schmidhuber a été surnommé « le père de l’IA » pour son travail sur le traitement du langage naturel au sein des réseaux de neurones – la technologie derrière Siri et Google Translate. Il a également écrit un grand nombre d’articles et a remporté des prix pour son travail.

Bien que lui et Hinton ne soient pas d’accord sur beaucoup de choses, ils conviennent tous les deux que le développement de l’IA ne peut pas être arrêté. Schmidhuber, cependant, a déclaré au Guardian qu’il pensait que les dangers étaient exagérés.

Steve Wozniak a été l’un de ceux qui privilégient une approche plus prudente, signant récemment une lettre ouverte appelant à suspendre le développement de l’IA au-delà de GPT-4.

Cependant, il semble être d’accord avec Hinton et Schmidhuber sur le fait que les progrès de l’IA ne peuvent pas être arrêtés.

Woz : l’IA ne peut pas être arrêtée, nous devons nous préparer aux arnaques

Woz a déclaré à la BBC que « nous ne pouvons pas arrêter la technologie », et il doutait que la réglementation puisse aider.

Il a déclaré que l’un des principaux dangers de l’IA générative est qu’elle peut aider à rendre les escroqueries plus difficiles à repérer, et que nous devons tous nous y préparer.

M. Wozniak dit qu’il craint que la technologie ne soit exploitée par de « mauvais acteurs » […] Il a dit : « L’IA est si intelligente qu’elle est ouverte aux mauvais joueurs, ceux qui veulent vous tromper sur qui ils sont » […]

M. Wozniak ne pense pas que l’IA remplacera les gens parce qu’elle manque d’émotion, mais il a averti que, selon lui, cela rendrait les mauvais acteurs encore plus convaincants, car des programmes comme ChatGPT peuvent créer des textes qui « semblent si intelligents ». […]

Il a émis une note de scepticisme quant au fait que les régulateurs feraient bien les choses : « Je pense que les forces qui recherchent l’argent l’emportent généralement, ce qui est plutôt triste. »

La clé, selon lui, est d’éduquer les gens sur les escroqueries et les attaques de phishing, car celles-ci ne peuvent que devenir plus difficiles à repérer.

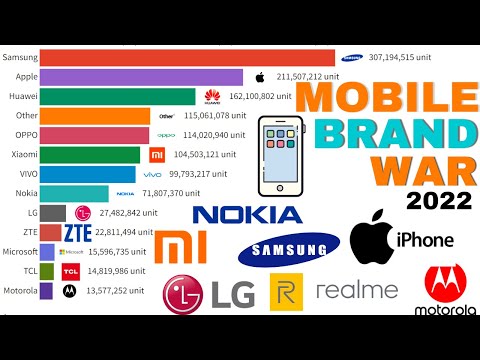

Détente, découvrez l’évolution du nombre de smartphones vendus par marque au fil du temps dans la vidéo ci-dessous :