Contexte : Pour certains, les assistants IA sont comme de bons amis vers qui on peut se tourner pour toute question sensible ou embarrassante. Cela semble sûr, après tout, car nos communications avec eux sont cryptées. Cependant, des chercheurs israéliens ont découvert un moyen permettant aux pirates informatiques de contourner cette protection.

Comme tout bon assistant, votre IA en sait beaucoup sur vous. Il sait où vous vivez et où vous travaillez. Il sait probablement quels aliments vous aimez et ce que vous comptez faire ce week-end. Si vous êtes particulièrement bavard, il saura peut-être même si vous envisagez un divorce ou une faillite.

C’est pourquoi une attaque conçue par des chercheurs capables de lire les réponses cryptées des assistants IA sur le Web est alarmante. Les chercheurs proviennent du laboratoire de recherche Offensive AI en Israël et ont identifié un canal secondaire exploitable présent dans la plupart des principaux assistants d’IA qui utilisent le streaming pour interagir avec de grands modèles de langage, à l’exception de Google Gemini. Ils démontrent ensuite comment cela fonctionne sur le trafic réseau crypté de ChatGPT-4 d’OpenAI et de Copilot de Microsoft.

« [W]Nous avons pu reconstruire avec précision 29 % des réponses d’un assistant IA et déduire avec succès le sujet à partir de 55 % d’entre elles », ont écrit les chercheurs dans leur article.

Le point d’attaque initial est le canal secondaire de la longueur du jeton. Dans le traitement du langage naturel, le jeton est la plus petite unité de texte porteuse de sens, expliquent les chercheurs. Par exemple, la phrase « J’ai une éruption cutanée qui démange » pourrait être symbolisée comme suit : S = (k1, k2, k3, k4, k5), où les jetons sont k1 = I, k2 = avoir, k3 = an, k4 = démangeaisons et k5 = éruption cutanée.

Cependant, les jetons représentent une vulnérabilité importante dans la manière dont les grands services de modèles de langage gèrent la transmission des données. À savoir, comme les LLM génèrent et envoient des réponses sous la forme d’une série de jetons, chaque jeton est transmis du serveur à l’utilisateur au fur et à mesure de sa génération. Bien que ce processus soit crypté, la taille des paquets peut révéler la longueur des jetons, permettant potentiellement aux attaquants du réseau de lire les conversations.

Déduire le contenu d’une réponse à partir d’une séquence de longueur symbolique est difficile car les réponses peuvent comporter plusieurs phrases, conduisant à des millions de phrases grammaticalement correctes, ont déclaré les chercheurs. Pour contourner ce problème, ils (1) ont utilisé un grand modèle de langage pour traduire ces séquences, (2) ont fourni au LLM un contexte inter-phrases pour restreindre l’espace de recherche, et (3) ont effectué une attaque en texte clair connu en affinant le modèle sur le style d’écriture du modèle cible.

« À notre connaissance, il s’agit du premier travail utilisant l’IA générative pour effectuer une attaque par canal secondaire », ont-ils écrit.

Les chercheurs ont contacté au moins un fournisseur de sécurité, Cloudflare, au sujet de leurs travaux. Depuis qu’il a été informé, Cloudflare affirme avoir mis en œuvre une mesure d’atténuation pour sécuriser son propre produit d’inférence appelé Workers AI, et l’avoir ajouté à sa passerelle AI pour protéger les LLM des clients, quel que soit l’endroit où ils les exécutent.

Dans leur article, les chercheurs ont également proposé une suggestion d’atténuation : inclure un remplissage aléatoire à chaque message pour masquer la longueur réelle des jetons dans le flux, compliquant ainsi les tentatives de déduction d’informations basées uniquement sur la taille des paquets réseau.

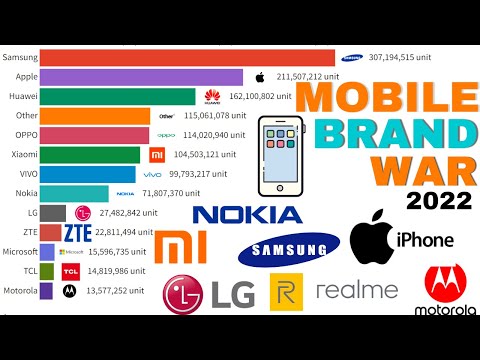

Détente, découvrez l’évolution du nombre de smartphones vendus par marque au fil du temps dans la vidéo ci-dessous :